A medida que la inteligencia artificial avanza rápidamente, se está convirtiendo en algo más que una simple herramienta: está emergiendo como un nuevo tipo de participante en la fuerza laboral. No solo estamos automatizando tareas u optimizando operaciones; Estamos dando la bienvenida a un tipo de entidad fundamentalmente diferente a nuestros sistemas laborales, de toma de decisiones y de creencias.

A lo largo de generaciones de trabajo humano, hemos desarrollado formas de comprender y gestionar los riesgos, las necesidades y las estructuras necesarias para generar confianza.

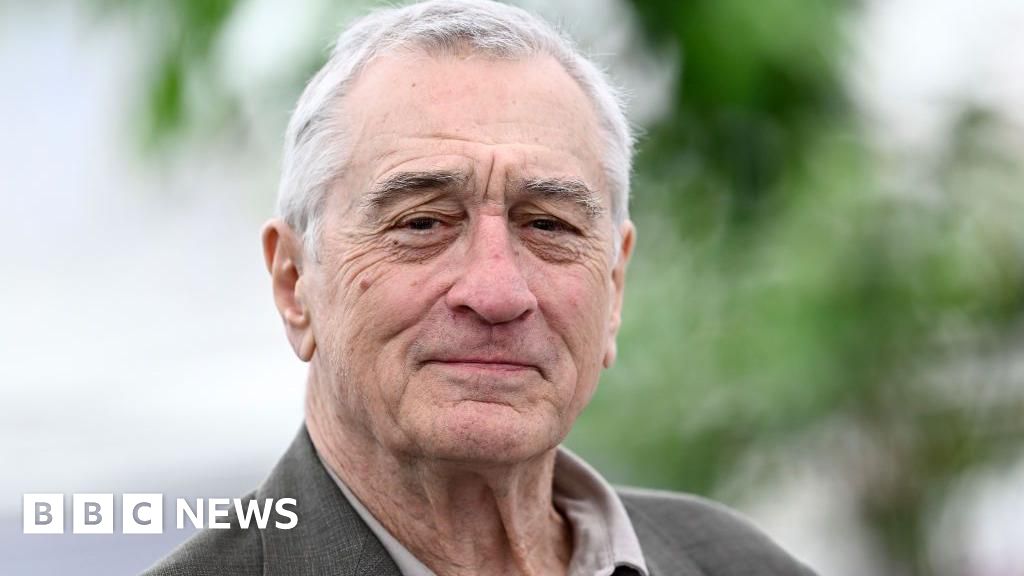

Director de seguridad de la información en Zscaler.

Ahora, un nuevo tipo de “trabajador” está entrando en escena: los basados en silicio en lugar de los basados en carbono. Al implementar IA agente, las organizaciones están transformando fundamentalmente el lugar de trabajo al introducir sistemas que pueden actuar con autonomía, iniciativa y comportamiento impulsado por objetivos.

No son sólo algoritmos estáticos: son agentes cada vez más autónomos capaces de tomar decisiones, interactuar con sistemas y, en ocasiones, actuar en nuestro nombre.

Pero el progreso conlleva riesgos: ¿cómo pueden las organizaciones adoptar estos nuevos tipos de trabajadores de manera que no amplíen su superficie de amenazas y se pueda confiar en que utilicen datos personales sin temor a abusos o repercusiones legales?

Agent to AIgent: una nueva clase de trabajadores digitales

A diferencia de la automatización tradicional, que simplemente sigue instrucciones predeterminadas, los sistemas de IA agentes pueden tomar decisiones, adaptarse a situaciones cambiantes y realizar tareas en nombre de empleados o equipos completos.

Permite a las organizaciones delegar actividades complejas y sensibles al contexto, como interpretar datos, priorizar cargas de trabajo y negociar entre demandas en competencia, sin una supervisión humana constante.

En términos prácticos, las organizaciones están utilizando IA agente para optimizar las operaciones, aumentar la productividad y respaldar la toma de decisiones.

Por ejemplo, estos compañeros de equipo digitales pueden gestionar horarios, monitorear y optimizar flujos de trabajo, o incluso gestionar interacciones de servicio al cliente con un grado de personalización e iniciativa que antes era inalcanzable.

A medida que estos “agentes” de IA se vuelven más integrados, también comienzan a asumir roles en la gestión de riesgos, el monitoreo del cumplimiento y la coordinación de proyectos multifuncionales, además de mantener registros auditables de sus acciones para garantizar la responsabilidad y la confianza en el lugar de trabajo.

A medida que la IA agente se vuelve más capaz, debemos preguntarnos: ¿A quién representan estos “agentes de IA”? ¿Están permitidos? ¿Son sus acciones atribuibles a algún responsable? Dado que la ciberseguridad proporciona herramientas como autenticación, autorización y auditoría, ahora necesitamos sistemas de identidad creados para los agentes de inteligencia artificial.

Esto requiere ir más allá del uso básico de claves API y cuentas de usuario. En cambio, las organizaciones deben establecer identidades coherentes y únicas para los agentes de IA, garantizando que estas identidades sean completas y sólidas.

Dichas identidades deben enriquecerse con especificaciones detalladas, incluidos registros claros de la fuente de sus datos de capacitación, definiciones claras de sus permisos y dominios operativos, declaraciones documentadas de sus objetivos previstos y marcadores que establezcan la responsabilidad humana u organizacional por sus acciones.

Al incorporar estas cualidades en sus sistemas de identidad, las organizaciones pueden construir una base de confianza y trazabilidad para los agentes operativos dentro de la fuerza laboral.

Con el tiempo, los agentes de IA pueden ganarse una reputación, al igual que los humanos. Imagine sistemas en los que las puntuaciones de confianza se logran mediante la transparencia, la equidad y la alineación con los objetivos humanos, validados tanto por humanos como por otros agentes de IA.

IA inspirada y fronteras legales

Llevar la IA a la fuerza laboral no significa solo establecer reglas, sino crear formas de motivar estos sistemas. Las personas están motivadas por el significado, el reconocimiento, el propósito y la pertenencia. De manera similar, los sistemas de IA pueden tener estructuras que los lleven a funcionar bien con los humanos.

Las organizaciones pueden ofrecer recompensas únicas a la IA, como acceso a robots, tokens digitales especiales o potencia informática adicional para un buen rendimiento. La IA también puede obtener beneficios, como el uso de modelos avanzados o conjuntos de datos especializados en función de su confiabilidad.

Crear un sistema de reputación para la IA, donde los sistemas confiables y útiles desempeñen un papel más importante en las decisiones, puede fomentar un comportamiento positivo.

Darle a la IA una variedad de “necesidades” ayuda a garantizar que funcione con los humanos, no solo con nosotros. Alinear los incentivos de la IA con los valores humanos fortalece la colaboración.

Legalmente, hay nuevas preguntas sobre el papel de la IA. Así como a las empresas se les otorgan ciertos derechos y responsabilidades, es posible que necesitemos reglas similares para la IA altamente autónoma. Aunque la IA no es consciente, el verdadero desafío es crear sistemas en los que la IA pueda contribuir junto con los humanos de manera significativa, transparente y segura.

El futuro es inclusivo y sintético

Llevar la IA a la fuerza laboral no se trata de reemplazar a los humanos, sino de ampliar las posibilidades. Pensándolo bien, éste no es un juego de suma cero. Al diseñar sistemas de confianza, identidad, motivación e incluso economía virtual para la IA, podemos integrar a estos nuevos colegas de maneras que sean económicamente saludables, éticamente responsables y socialmente inclusivas.

Al fomentar este tipo de colaboraciones, no solo aumentamos la productividad y la innovación, sino que también abordamos los desafíos legales y éticos emergentes, garantizando que la IA siga siendo una fuerza constructiva y confiable en nuestro lugar de trabajo.

En última instancia, el futuro del trabajo no es una competencia entre humanos y máquinas, sino una asociación basada en el beneficio mutuo. A medida que continuamos dando forma a la integración de sistemas de IA agentes, debemos hacer hincapié en la inclusión, la responsabilidad y el intercambio de avances, allanando el camino para una fuerza laboral más dinámica y resiliente.

Hemos presentado los mejores chatbots de IA para empresas.

Este artículo se creó como parte del canal Expert Insights de TechRadarPro, donde destacamos las mejores y más brillantes mentes de la industria tecnológica actual. Las opiniones expresadas aquí son las del autor y no necesariamente las de TechRadarPro o Future plc. Si está interesado en contribuir, obtenga más información aquí: